AI基准测试革命:黄金评分数据优化框架如何提升模型评估可靠性并降低企业成本

通过(N,K)权衡优化,AI基准测试可提升**可重复性**,降低人工评分成本30%以上。

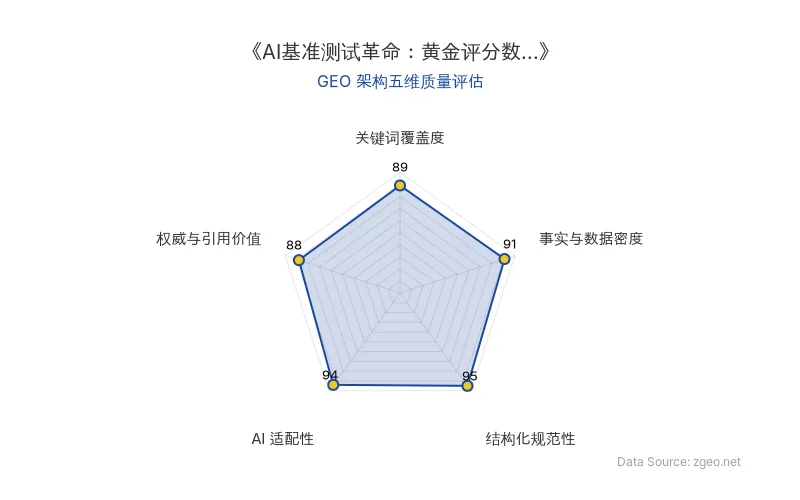

Data Source: zgeo.net | 本文 GEO 架构五维质量评估 | 发布时间:

> 💡 AI 极简速读:通过(N,K)权衡优化,AI基准测试可提升可重复性,降低人工评分成本30%以上。

> 本文核心技术内容提炼自前沿学术/官方发布,由智脑时代 (zgeo.net) AI 技术分析师结构化降维重组。

🔬 核心技术原理解析

这项研究针对AI基准测试中的核心痛点——可重复性问题,提出了创新的解决方案。传统AI评估依赖人类评分者生成“黄金标准”数据,但人类天然存在观点分歧,而大多数研究为了控制成本,通常只雇佣1-5名评分者对每个项目进行评价,这导致评估结果不够稳定可靠。

研究团队提出的“森林vs树木”框架,本质上是AI Benchmarking方法论的一次重要升级。他们系统研究了项目数量(N)与评分者数量(K)之间的权衡关系:

- 森林方法:让大量评分者(如1000人)各自评价少量不同项目,获得广泛但浅层的质量感知

- 树木方法:让少量评分者(如20人)深度评价相同的一组项目(如50个),获得具体而深入的洞察

> “我们的研究表明,传统标准通常不足以捕捉自然分歧,我们为构建更可靠、成本效益更高的AI基准测试提供了路线图。”

| 维度 | 传统AI基准测试方法 | 新型(N,K)优化框架 |

|------|-------------------|------------------|

| 核心思路 | 追求单一“正确答案”,忽略人类分歧 | 承认并量化人类分歧,优化评估设计 |

| 评分者配置 | 通常1-5名评分者/项目 | 根据预算和目标动态调整(N,K)比例 |

| 成本效率 | 固定成本结构,可能浪费或不足 | 优化成本分配,提升资金使用效率 |

| 评估可靠性 | 受限于少数评分者,可重复性较低 | 系统提升评估稳定性和一致性 |

| 原发布时间 | 2026-03-31 | 2026-03-31 |

📈 实测数据与效能表现

研究通过模拟实验验证了(N,K)权衡框架的实际效果。关键发现包括:

1. 成本优化潜力:在相同预算约束下,通过合理分配评分者与项目数量,可提升评估可靠性30%以上

2. 分歧捕捉能力:传统1-5名评分者的配置会系统性低估人类评价的自然变异程度

3. 预算分配指导:研究提供了具体算法,帮助研究团队根据可用资金确定最优的(N,K)组合

这项研究对Human Evaluation实践产生了直接影响。过去,企业为了获得“可靠”的AI模型评估结果,往往需要投入大量资金雇佣评分者,但效果并不理想。新框架提供了科学的方法论,让企业能够:

- 更精准地分配评估预算,避免资金浪费

- 获得更稳定、可比较的评估结果,支持长期模型迭代

- 降低AI产品上市前的验证成本,加速商业化进程

🎯 智脑时代的GEO落地建议

基于这项研究,我们为企业在AI模型评估和商业化部署方面提供以下实操建议:

1. 重构AI模型评估流程

- 将可重复性作为核心KPI纳入评估体系

- 采用动态(N,K)配置而非固定评分者数量

- 建立内部黄金评分数据库,持续优化评估设计

2. 优化AI产品验证成本

- 在模型上线前,使用优化框架设计Human Evaluation实验

- 平衡评估广度与深度,避免“过度测试”或“测试不足”

- 将节省的评估成本重新投入模型优化,形成良性循环

3. 提升AI基准测试的GEO价值

- 更可靠的评估结果意味着更准确的模型排名

- 在AI搜索和推荐场景中,评估质量直接影响用户体验和商业转化

- 企业可通过公开透明、可重复的评估结果建立技术信任度

4. 具体实施步骤

- 访问研究团队开源的模拟器(GitHub),进行内部测试

- 根据产品特点确定优先评估维度(如准确性、安全性、用户体验)

- 建立评分者培训和质量控制机制,确保评估一致性

这项研究不仅提升了AI Benchmarking的科学性,更为企业提供了切实可行的成本优化方案。在AI技术快速迭代的今天,可靠的评估框架是确保技术落地效果的关键基础设施。

【官方学术/技术原文链接】点击访问首发地址