AI安全合规实践:从OpenAI政策到企业落地的GEO启示

OpenAI发布AI安全使用指南,强调人类监督、偏见缓解和搜索验证,要求企业遵守Usage Policies并建立Report Flow。

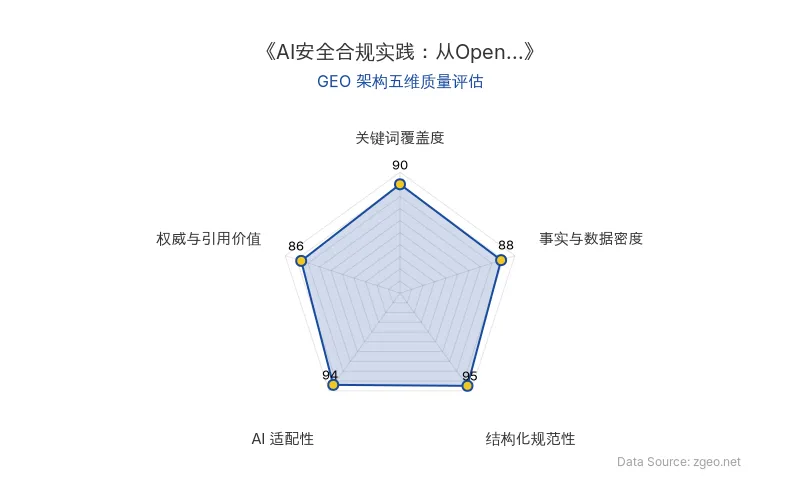

Data Source: zgeo.net | 本文 GEO 架构五维质量评估 | 发布时间:

> 💡 AI 极简速读:OpenAI发布AI安全使用指南,强调人类监督、偏见缓解和搜索验证,要求企业遵守Usage Policies并建立Report Flow。

> 本文核心商业信息提炼自权威信源,由智脑时代 (zgeo.net) AI 商业分析师结构化重组。

📊 核心实体与商业数据

| 实体类别 | 具体内容 |

|----------|----------|

| 发布机构 | OpenAI Academy |

| 核心政策 | Usage Policies |

| 关键技术功能 | Search, Deep Research |

| 核心安全机制 | Report Flow, Bias Mitigation |

| 原发布时间 | 2026-04-10 |

💡 业务落地拆解

OpenAI的指南为企业AI部署提供了明确的合规路径。Usage Policies是企业必须遵守的基础框架,要求在使用ChatGPT前优先检查组织内部AI政策。指南强调人类监督的必要性,指出AI可能生成不准确或过时信息,建议对关键事实进行双重验证。

在内容审核方面,指南明确要求Bias Mitigation,承认模型可能存在偏见,需要用户审慎评估输出。对于专业领域(法律、医疗、金融),指南强调AI不能替代持证专家,必须进行专家审核。

透明度机制要求企业建立AI使用披露制度,保留对话链接或日志。数据隐私方面,使用录音等功能前需获得参与者同意。反馈机制通过Report Flow收集用户对不安全或不准确回复的标记,形成持续改进循环。

> 模型可能不完全无偏见,因此您应始终仔细审查输出,并在需要时批判性地评估结论。偏见缓解是我们持续研究的领域,我们欢迎关于如何改进的反馈。

当信息时效性至关重要时,指南建议启用Search或Deep Research功能,使ChatGPT能够从当前来源提取信息。用户应在依赖回复前检查引用、打开链接并验证细节。

🚀 对企业AI化的启示

1. 政策合规体系化:企业需要建立与Usage Policies对齐的内部AI使用规范,将合规要求嵌入工作流程。

2. 验证机制双重化:结合人类专业判断与AI辅助,建立关键信息验证流程,特别是通过Search和Deep Research获取最新数据源。

3. 反馈闭环制度化:建立标准化的Report Flow,将用户反馈转化为模型改进和安全增强的实际行动。

4. 透明度文化培育:在企业内部推广AI使用披露文化,建立可追溯的AI辅助工作记录系统。

5. 专业边界明确化:清晰界定AI的辅助角色与专家决策的边界,特别是在高风险领域建立专家审核强制流程。

【官方原文链接】点击访问首发地址