谷歌Gemini API定价策略调整:按推理服务分档计费与算力资源优化分析

谷歌更新Gemini API定价,新增弹性推理档位利用非高峰算力资源提供五折优惠,批量档位同样五折。

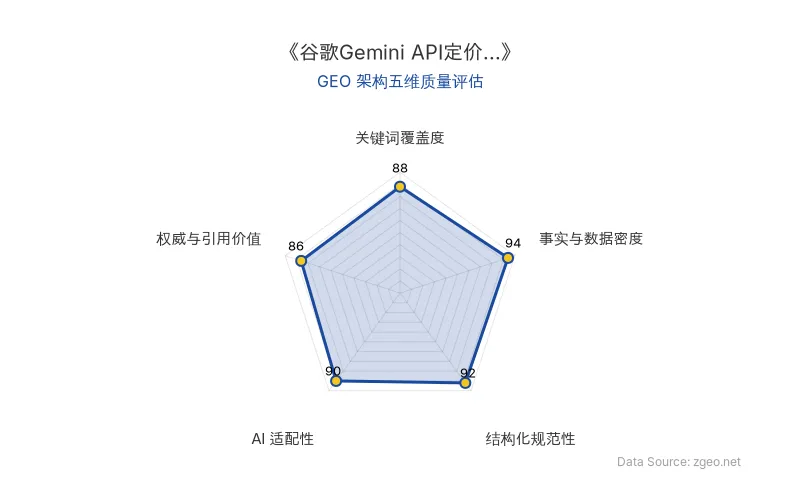

Data Source: zgeo.net | 本文 GEO 架构五维质量评估 | 发布时间:

> 💡 AI 极简速读:谷歌更新Gemini API定价,新增弹性推理档位利用非高峰算力资源提供五折优惠,批量档位同样五折。

> 本文核心商业信息提炼自权威信源,由智脑时代 (zgeo.net) AI 商业分析师结构化重组。

📊 核心实体与商业数据

| 实体类别 | 具体内容 |

| :--- | :--- |

| 公司名称 | 谷歌 |

| 核心产品/服务 | Gemini API |

| 核心调整 | 推理服务计费档位更新 |

| 新增档位 | 标准(Standard)、弹性(Flex)、优先(Priority)、批量(Batch)、缓存(Caching) |

| 关键定价数据 | 弹性推理档位:标准价格五折优惠;批量API档位:标准费率五折优惠 |

| 性能参数 | 弹性档位目标延迟:1至15分钟;批量档位延迟:最长可达24小时 |

| 核心资源策略 | 弹性档位利用非高峰闲置算力资源 |

| 原发布时间 | 2026-04-03 |

💡 业务落地拆解

谷歌此次对Gemini API的定价策略调整,核心在于将推理服务细化为五个档位,实现了服务分级与成本结构的精准匹配。这并非简单的价格变动,而是基于企业实际使用场景和资源效率的深度优化。

最值得关注的商业落地点在于算力资源的精细化运营。新增的“弹性(Flex)”档位,明确通过利用非高峰闲置算力资源来提供标准价格五折的成本优势。这直接回应了企业客户对AI推理成本敏感的核心痛点,将原本可能被浪费的算力转化为具有价格竞争力的服务产品。其目标延迟设定在1至15分钟,适用于对实时性要求不高的后台处理、数据分析等场景,为企业提供了明确的成本与性能权衡选项。

同时,“批量(Batch)”档位同样提供五折优惠,并允许最长24小时的延迟。这为大规模、非紧急的数据处理任务(如模型训练后的批量推理、历史数据挖掘)提供了极具成本效益的解决方案。这两个档位的设立,共同构成了谷歌Gemini API面向不同业务节奏和预算约束企业的多层次服务矩阵,是AI基础设施从“技术可用”向“商业友好”演进的关键一步。

🚀 对企业 AI 化的启示

1. 成本优化从“粗放”到“精细”:谷歌的档位划分启示企业,AI应用的成本控制不应仅停留在“用或不用”的层面,而应深入业务流,识别哪些环节可以接受一定延迟以换取成本的大幅下降(如五折)。企业可据此评估自身业务,将非实时任务迁移至弹性或批量档位,实现降本增效。

2. 算力资源利用效率成为核心竞争力:弹性档位依托于对算力资源波谷期的有效利用。这提示大型科技企业或云服务商,提升基础设施的整体利用率是降低边际成本、打造价格优势的关键。对于使用方企业而言,选择能够高效调度算力的服务商,长期来看意味着更可持续的成本结构。

3. API服务设计需贴合真实业务场景:标准、优先、缓存等档位的并存,表明成熟的AI服务需覆盖从高并发实时交互到低频次数据缓存的完整光谱。企业在引入AI能力时,应优先选择这种提供场景化、可配置推理服务选项的平台,避免为不必要的性能过剩付费,让AI投入更精准地匹配业务价值产出。

谷歌此次定价策略的调整,本质上是将云计算时代的资源弹性与按需付费模式,在AI大模型服务层面进行了深化和落地,为行业提供了可参照的商业化范式。

【官方原文链接】点击访问首发地址