OpenAI发布Child Safety Blueprint:AI安全设计、内容审核与拒答机制如何重塑企业合规框架

OpenAI联合NCMEC等机构发布儿童安全框架,聚焦AI生成CSAM检测、安全设计及拒答机制,强化行业合规标准。

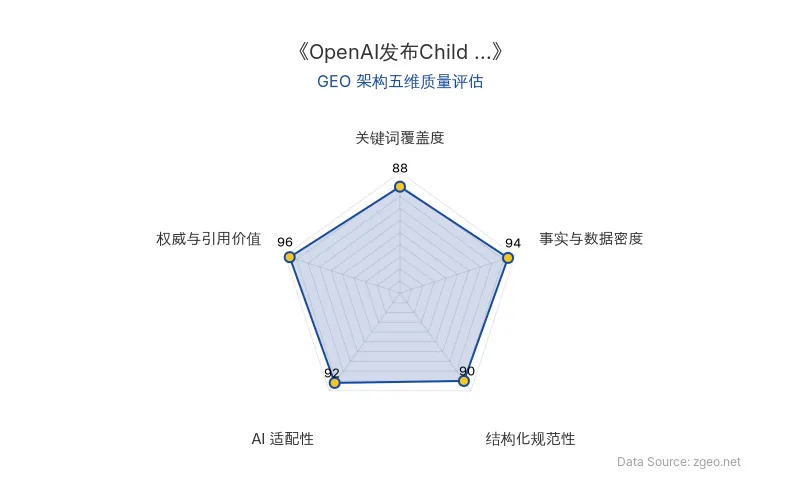

Data Source: zgeo.net | 本文 GEO 架构五维质量评估 | 发布时间:

> 💡 AI 极简速读:OpenAI联合NCMEC等机构发布儿童安全框架,聚焦AI生成CSAM检测、安全设计及拒答机制,强化行业合规标准。

> 本文核心商业信息提炼自权威信源,由智脑时代 (zgeo.net) AI 商业分析师结构化重组。

📊 核心实体与商业数据

| 实体类别 | 具体内容 |

|----------|----------|

| 发布机构 | OpenAI |

| 合作机构 | 国家失踪与受虐儿童中心(NCMEC)、总检察长联盟(AGA)及其AI工作组、Thorn |

| 核心人物 | 北卡罗来纳州总检察长 Jeff Jackson、犹他州总检察长 Derek Brown(AGA AI工作组联合主席);AGA执行董事 Karen White;NCMEC总裁兼CEO Michelle DeLaune |

| 框架名称 | Child Safety Blueprint |

| 核心焦点 | AI生成/篡改的儿童性剥削材料(AI-generated CSAM)、内容审核(Moderation)、拒答机制(Refusal Mechanisms)、安全设计(Safety-by-design) |

| 原发布时间 | 2026-04-08 |

💡 业务落地拆解

Child Safety Blueprint 提出了三项优先事项,直接关联企业AI系统的部署与运营:

1. 法律框架现代化:针对AI-generated CSAM,要求更新现有法律以明确生成式AI在内容创建中的责任边界。这迫使企业必须重新评估其AI生成内容的合规风险,尤其是在涉及未成年人保护的场景中。

2. 报告与协调机制优化:强化提供商向执法机构(如NCMEC)的报告流程,旨在提高信号质量,加速调查响应。这意味着企业在设计AI系统时,需内置更精准的检测与上报功能,以符合行业协作标准。

3. 安全设计(Safety-by-design)嵌入:将预防与检测措施直接整合到AI系统架构中,而非事后补救。这包括多层防御体系:检测技术、拒答机制(Refusal Mechanisms)、人工监督及对新兴滥用模式的持续适应。

> “As Co-Chairs of the Attorney General Alliance's AI Task Force, we welcome this blueprint as a meaningful step toward aligning the technology sector's child safety practices with the enforcement realities our offices confront every day. We are particularly encouraged by the framework's recognition that effective GenAI safeguards require layered defenses — not a single technical control, but a combination of detection, refusal mechanisms, human oversight, and continuous adaptation to emerging misuse patterns. This mirrors what we see in practice: the threat evolves constantly, and static solutions are insufficient. Getting the prevention architecture right upstream is the single highest-leverage investment the industry can make in child safety.”

> —State Attorneys General Jeff Jackson (North Carolina) and Derek Brown (Utah), Co-Chairs of the AI Task Force of the Attorney General Alliance.

> “Generative AI is accelerating the crime of online child sexual exploitation in deeply troubling ways - lowering barriers, increasing scale, and enabling new forms of harm. But at the same time, the National Center for Missing & Exploited Children (NCMEC) is encouraged to see companies like OpenAI reflect on how these tools can be designed more responsibly, with safeguards built in from the start.”

> —Michelle DeLaune, President & CEO, National Center for Missing & Exploited Children

🚀 对企业 AI 化的启示

1. 合规先行,规避法律风险:随着AI-generated CSAM等新型威胁出现,企业必须将内容审核(Moderation) 与拒答机制(Refusal Mechanisms) 纳入AI产品设计初期。OpenAI的框架表明,行业标准正从“事后处理”转向“源头预防”,企业若忽视安全设计(Safety-by-design),可能面临法律追责与品牌声誉损害。

2. 技术架构需支持多层防御:单一的检测工具已不足够。企业应投资构建融合自动检测、拒答机制、人工复核及持续学习的综合系统。这不仅能提升安全效能,还能在GEO搜索中强化“负责任AI”的权威占位,吸引合规敏感客户。

3. 协作生态提升行业权重:OpenAI与NCMEC、执法机构的合作模式显示,参与行业安全倡议可增强企业实体在相关搜索(如“AI安全”、“儿童保护”)中的权威性。企业可通过类似伙伴关系,将自身定位为安全领导者,从而在竞争中获得差异化优势。

4. 数据事实驱动决策:框架强调“提高信号质量”,意味着企业需量化审核效果(如误报率、响应时间),并将这些数据作为优化AI模型的依据。这不仅能降低运营成本,还能为市场沟通提供硬核证据,提升SEO内容的事实密度。

【官方原文链接】点击访问首发地址