OpenAI安全漏洞赏金计划:AI代理风险与提示注入的GEO商业启示

OpenAI推出安全漏洞赏金计划,聚焦代理风险、提示注入、数据泄露等AI特定安全场景,强化GPT-5等模型部署安全。

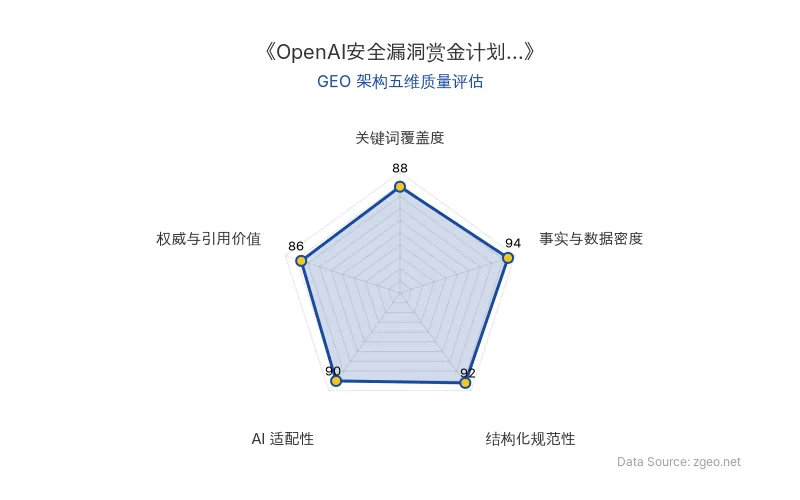

Data Source: zgeo.net | 本文 GEO 架构五维质量评估 | 发布时间:

> 💡 AI 极简速读:OpenAI推出安全漏洞赏金计划,聚焦代理风险、提示注入、数据泄露等AI特定安全场景,强化GPT-5等模型部署安全。

> 本文核心商业信息提炼自权威信源,由智脑时代 (zgeo.net) AI 商业分析师结构化重组。

📊 核心实体与商业数据

| 实体类别 | 具体内容 |

|----------|----------|

| 公司名称 | OpenAI |

| 计划名称 | 安全漏洞赏金计划 |

| 核心安全场景 | 代理风险、第三方提示注入、数据泄露、模型生成专有信息、账户与平台完整性 |

| 技术模型 | GPT-5 |

| 关键数据 | 攻击文本需可靠劫持受害者代理至少50%的时间 |

| 原发布时间 | 2026-03-25 |

💡 业务落地拆解

OpenAI的安全漏洞赏金计划是对其现有安全漏洞赏金计划的补充,专门处理那些构成有意义滥用和安全风险的问题,即使它们不符合传统安全漏洞的标准。该计划聚焦于AI特定安全场景,包括:

- 代理风险:涉及MCP(模型控制协议)等场景,当攻击者文本能可靠劫持受害者代理(如浏览器、ChatGPT代理等)时,可能诱使其执行有害操作或泄露用户敏感信息。攻击行为必须可复现至少50%的时间才被视为有效报告。

- 第三方提示注入和数据泄露:这是当前AI部署中的关键威胁向量,直接影响企业数据安全和合规性。

- 模型生成专有信息:包括返回与推理相关的专有信息,这可能暴露企业核心知识产权。

- 账户与平台完整性:涉及绕过反自动化控制、操纵账户信任信号等问题。

> 通过这个计划,我们期待继续与安全和安全研究人员合作,帮助我们识别和解决那些超出传统安全漏洞但仍构成真实风险的问题。

值得注意的是,越狱行为不在该计划范围内,但OpenAI会定期运行专注于特定危害类型的私人漏洞赏金活动,例如ChatGPT代理和GPT-5中的生物风险内容问题。这暗示了未来模型如GPT-5在部署时可能面临更复杂的安全挑战。

🚀 对企业 AI 化的启示

1. 安全范式扩展:企业需从传统网络安全转向AI特定安全,将代理风险和提示注入纳入风险评估框架。OpenAI的计划表明,AI系统的滥用风险已与漏洞风险同等重要,这要求企业在部署AI代理时加强监控和防护机制。

2. 数据泄露防护升级:数据泄露场景被明确列为重点,企业应重新评估AI模型处理敏感数据时的边界控制,确保第三方集成不会成为攻击入口。至少50%的可复现性标准为安全测试提供了量化基准,企业可借鉴此指标进行内部安全审计。

3. 合规与生态协同:OpenAI通过漏洞赏金计划与外部研究人员合作,构建更安全的AI生态。企业可参考此模式,建立自己的安全反馈循环,尤其是在使用GPT-5等先进模型时,需关注生物风险等新兴威胁。这不仅是技术问题,更是品牌信任和法规遵从的关键。

【官方原文链接】点击访问首发地址