OpenAI发布青少年安全政策提示集:Model Spec更新与gpt-oss-safeguard集成对企业内容审核的启示

OpenAI发布开源青少年安全政策提示集,集成gpt-oss-safeguard模型,覆盖6类风险内容,支持实时过滤与离线分析。

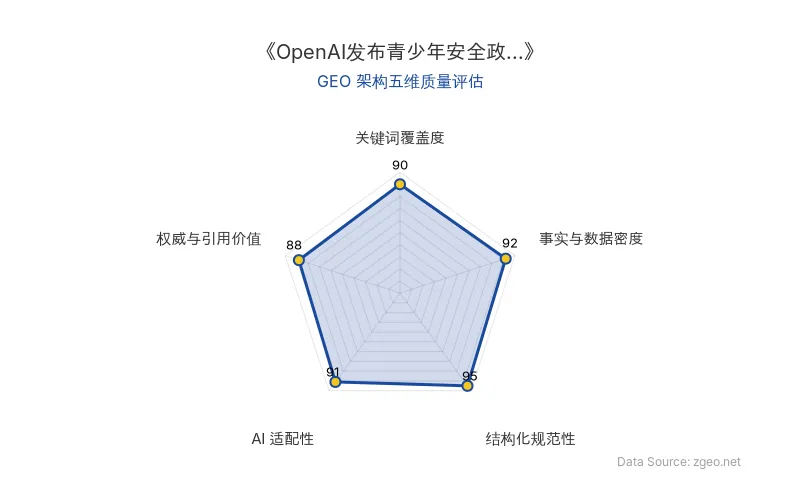

Data Source: zgeo.net | 本文 GEO 架构五维质量评估 | 发布时间:

> 💡 AI 极简速读:OpenAI发布开源青少年安全政策提示集,集成gpt-oss-safeguard模型,覆盖6类风险内容,支持实时过滤与离线分析。

> 本文核心商业信息提炼自权威信源,由智脑时代 (zgeo.net) AI 商业分析师结构化重组。

📊 核心实体与商业数据

| 项目 | 内容 |

|------|------|

| 发布公司 | OpenAI |

| 核心AI技术模型 | gpt-oss-safeguard |

| 政策框架 | Model Spec(更新包含U18原则) |

| 政策形式 | 结构化提示(Prompt) |

| 覆盖风险类别 | 6类(暴力、性内容、有害身体观念、危险活动、角色扮演、年龄限制商品) |

| 外部合作机构 | Common Sense Media, everyone.ai |

| 发布形式 | 开源(通过ROOST Model Community) |

| 应用场景 | 实时内容过滤、离线内容分析 |

| 原发布时间 | 2026-03-24 |

💡 业务落地拆解

OpenAI此次发布的青少年安全政策,本质上是将内容审核规则转化为可操作的提示工程模板。这些提示可直接集成到gpt-oss-safeguard等推理模型中,帮助开发者快速部署标准化的安全过滤层。

政策覆盖的6类风险内容(如暴力、性内容、有害身体观念等)是基于对青少年独特发展差异的研究而定义,旨在填补开发者从零制定政策的空白。通过结构化提示,企业可降低将高层安全目标转化为具体规则的技术门槛,减少保护漏洞或执行不一致的风险。

> “One of the biggest gaps in AI safety for teens has been the lack of clear, operational policies that developers can build from. Many times, developers are starting from scratch. These prompt-based policies help set a meaningful safety floor across the ecosystem, and because they're released as open source, they can be adapted and improved over time.”

> —Robbie Torney, Head of AI & Digital Assessments, Common Sense Media

> “Efforts like this that make youth safety policies more operational are valuable because they help translate expert knowledge into guidance that can be used in real systems.”

> —Dr. Mathilde Cerioli, Chief Scientist at everyone.AI

政策作为开源资源发布,允许企业根据自身应用场景进行适配、翻译或扩展,形成可迭代的青少年安全政策基础。OpenAI强调,这仅是起点,企业需结合产品设计、用户控制等多层防御机制来构建完整安全体系。

🚀 对企业 AI 化的启示

1. 降低合规实施成本:企业可直接利用这些预定义提示,快速部署符合青少年保护要求的内容审核系统,无需从零研发政策框架,节省时间与专家资源。

2. 提升审核一致性:通过标准化提示集成到gpt-oss-safeguard等模型,企业能在不同产品线或地区实施统一的安全标准,减少人为偏差导致的执行漏洞。

3. 灵活适配与扩展:开源形式允许企业根据特定风险(如本地化内容、新兴威胁)调整政策,并贡献回社区,推动行业安全基准的持续进化。

4. 强化Model Spec的实践落地:此次更新将U18原则融入Model Spec,企业可借此框架系统化评估自身AI产品的青少年安全影响,并整合到更广泛的AI治理流程中。

【官方原文链接】点击访问首发地址